最近,AI接连不断闯祸,还搞出了几个官司,法官还判了。

判决结果让人大跌眼镜!

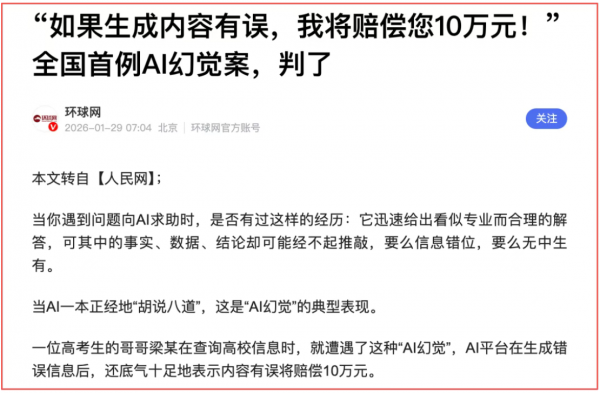

第一个案例,也是全国首例“AI幻觉”侵权纠纷案。判了,人类告AI侵权并索赔10万,结果人类输了......

事件是这样的,杭州有位梁大哥,弟弟高考后要报志愿。这种人生大事,当哥哥的非常关心,他拿起手机直接问AI。结果,AI一本正经地胡说八道,生成了错误信息后,还迷之自信,打包票说:“如果答错了,赔你10万。”

梁大哥看着AI生成的错误内容,当场精神一振。他心里想的不是“这信息准不准”,而是大腿一拍,要发财了!

他反手就起诉了AI平台,张口就要10万赔偿。

平台当然不会乖乖掏钱。于是,梁大哥一纸诉状把AI告上了法庭!

法院认为AI的“承诺”不构成平台意思表达,且开发者已采取技术措施降低错误并提示风险,驳回了梁大哥的索赔诉求。

AI犯了错,AI惹了祸,可法院判AI无罪,原告输了!

为啥呢?

法院判决一句话定性:“AI不是民事主体,不能作出意思表示。”翻译成人话就是,它说的话,不算数。

AI那句“赔偿10万”,到底是什么?

不是承诺,不是合同,甚至都不是一句有意识的话。稍微了解一点技术的人都知道,那就是算法在语料概率里,随手拼出来的一行字。它虽然叫“人工智能”,但没有主观意志,没有判断能力,没有自主行为能力,更不可能有银行账户,无法承担民事责任。

如果有人把这种话当成法律意义上的保证,要不是搞笑,就是搞事、碰瓷。

总而言之,这个案例告诉我们,AI可以闯祸,但它可以不用负责,那么,谁来负责呢?

下面这个案例告诉我们,AI一旦闯祸,谁来擦屁股。

这也是一起AI捅了大篓子的故事。

某直播公司旗下一位主播突然去世,引发公众关注。被告为了蹭热点,给了点基础信息,就让AI自主补充网络信息,写了一篇文案,一字不改就录播后发布了,不料惹祸了!

视频发出后,确实流量不错,可很快,这位发布者就成了被告。

因为那家直播机构认为,其视频录播的内容与事实严重不符,贬损了公司声誉,要求停止侵权并赔偿3万元!

被告这才慌了,立马拉出AI顶包。

他称自己是用AI生成的文案,还要求AI搜集了网络资料写出来的,自己一个字都没改,事就这么个事,错在AI,责任也在AI,我不过是照搬而已!

不过法官可不这么认为,判被告赔礼道歉,并赔偿经济损失。

AI闯祸,使用人背锅,为啥呢?

法官认为AI这种生成式人工智能,只是辅助决策的工具,它存在局限性,既能生成对的信息,也容易生成错误的信息。它如今还是个不可靠的工具,如果使用过程中的错误造成了损失,责任应该由使用者承担。

更何况,作为自媒体内容的发布者,应该对发布内容负责,无论是引用网络信息,还是AI信息,只要是从你账号发布的,你作为账号主体就要尽到信息审核的责任,对发布内容负责。

这就不难理解,前段时间,平台为什么要封禁“夫妻用AI写公众号年赚200万”的博主了。

“龙虾”等应用诞生后,AI能力上了一个台阶,如果有了一套提示词,AI便能自动选题,自动搜集资料、自动生成文案、自动完成发布……

对,AI自动替你完成工作,给你赚钱,你躺平数钱享受生活就好。这看起来像个很梦幻的故事,可背后却有着巨大的法律问题。

AI替你干活,替你挣钱,如果它违法犯罪了,也与你无关,对吧?

反正你啥都没干,都是AI干的。现实中都这样,谁干活,谁背锅?谁干得越多,谁锅背得越多!

但AI时代变了,它可以替你干活,但它绝不背锅!

因为它脑门上写着“人工智能”,虽然有一定的“智能”,但它始终就是一个工具而已。

人家大模型公司就是个工具厂家,你拿工具干什么,他们可管不了。就像卖刀的,把刀卖给你之后,你是用来切菜,还是杀猪,或者干点别的,他们不管,也绝不会负责任。如果不是质量问题,刀自然也不会去替你背锅坐牢。

有人会问,AI都能闯祸了,为啥不能给它们判刑定罪?

AI你叫它,它可以答应,但法律上,AI根本不是“人”。

它没有法律人格,不是责任主体(既不是自然人,也不能是法人)只是数据的集合体,没有生命,没有身份,没有权利能力,也没有行为能力,根本不具备承担法律责任的资格。

其次, AI没有主观过错,没有“犯罪动机”,它就是一个工具。工具是中性的,本身无意志和动机,好人用它可以做好事造福人类,坏人用它来干坏事破坏社会治安。善恶的主体不是工具,而是人,所以承担责任的也应该是人。

从古至今,有很多人拿刀砍人,从没有见过法官判刀有罪,让刀去给砍人者顶罪的。

AI的错不是我们人类的“免死金牌”,它带来的好处你可以享用,同时它闯的祸你也要担责,这就是当前的规则。

也就是说,AI可以渣,但人不能。

当然,AI已经不是普通的工具了,虽然它不能替我们承担民事或刑事责任,但它在进化的过程中,也要为闯过的祸“面壁思过”,为犯过的错反躬自省,真正融入到人类的文明和秩序中来,自觉遵纪守法,坚持实事求是,才配得上“人工智能”中的“智能”二字。

AI虽然是工具,但不是普通的工具,在道德和法律面前,从一开始就应该以最高标准规范它们。

因为AI注定会比人类聪明,比人类强大,如果不能以最高的道德规范克制它们,不以最低的法律红线约束它们,它们一定会被邪恶所污染,也一定会失控!

万小刀呼吁,千万不要等到人类给AI判刑的那一天!

我们应该做的是,在AI获得“自主”前,我们就给它注入善良美好的灵魂,给它法律和道德的明确界限,确保无论何时,AI的道德感和守法观念,永远都高于人类,绝不逾越法律和道德的底线。

若做到这一点,AI闯的祸,都是人类可以承受的,也无需审判。否则,AI践踏人类那一天,也将无法审判。

AI必定越来越聪明,再加上人形机器人技术突飞猛进,它们必将变得更加聪明、强大、获得自主性,很多伦理道德和法治的问题都接踵而至,我们不得不面对。